Οι νέες δυνατότητες χειραγώγησης

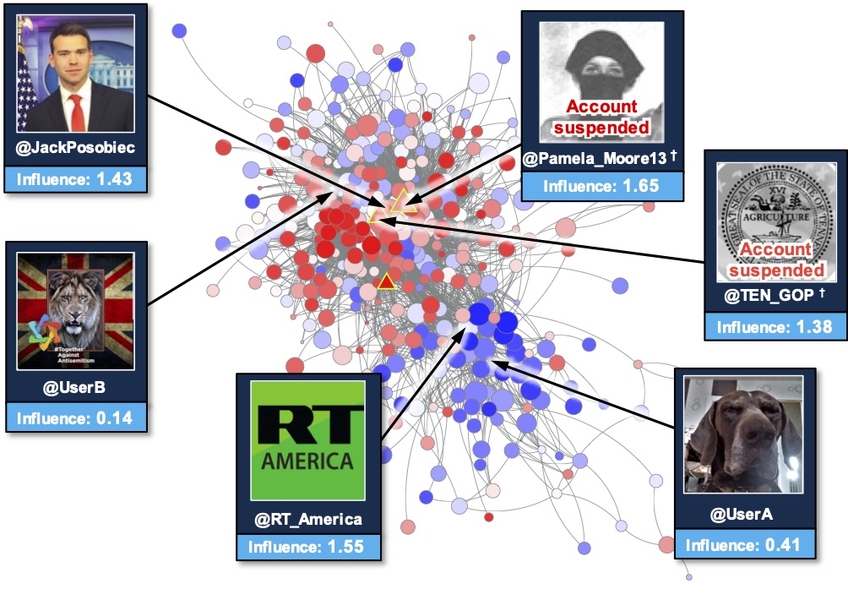

Η ραγδαία διάδοση των μεγάλων γλωσσικών μοντέλων, των εικονικών συνομιλητών(ChatBots) και των συστημάτων τεχνητής νοημοσύνης μετατρέπει αυτά τα εργαλεία σε βασικούς μεσάζοντες ανάμεσα στον πολίτη και το ψηφιακό πληροφοριακό περιβάλλον του. Δεν αναζητούμε πια μόνοι μας τις πηγές, αλλά λαμβάνουμε έτοιμες συνόψεις, απαντήσεις και αφηγήσεις. Αυτό όμως αυξάνει θεαματικά τα περιθώρια για οργανωμένες επιχειρήσεις χειραγώγησης πληροφορίας και ξένης παρέμβασης, καθώς τα ίδια τα μοντέλα μπορούν να καταστούν φορείς παραπληροφόρησης, είτε μέσω μολυσμένων δεδομένων εκπαίδευσης είτε μέσω στοχευμένης αλλοίωσης της «ευθυγράμμισής» τους με συγκεκριμένες πολιτικές ή εμπορικές σκοπιμότητες. Παράλληλα, η εκρηκτική ανάπτυξη συστημάτων παραγωγής εικόνας, ήχου και βίντεο καθιστά τα ψεύτικα βίντεο(deepfakes) φθηνά, ρεαλιστικά και εύκολα στη μαζική διάδοση, επιτρέποντας σε κακόβουλους δρώντες να προσαρμόζουν μηνύματα σε συγκεκριμένες ομάδες με ακρίβεια, ταχύτητα και ελάχιστο κόστος. Το αποτέλεσμα είναι ένα περιβάλλον όπου ο πολίτης βομβαρδίζεται από «προσωποποιημένο» περιεχόμενο, αλλά με ελάχιστη ορατότητα στο ποιος το παράγει, με ποιον σκοπό και με βάση ποια δεδομένα.

Από την επιστημονική παραπληροφόρηση στην αλλοίωση των ίδιων των μοντέλων

Το άρθρο στο Politikon αξιοποιεί το παράδειγμα της επιστημονικής παραπληροφόρησης για να δείξει ότι το πρόβλημα δεν είναι μόνο τα ψευδή γεγονότα, αλλά οι μακροπρόθεσμες γνωσιακές συνέπειες. Η ιστορία της ψευδούς σύνδεσης του εμβολίου MMR με τον αυτισμό δείχνει πως, ακόμη και όταν ένα ψευδές άρθρο αποσυρθεί, η ζημιά στη δημόσια εμπιστοσύνη μπορεί να διαρκέσει δεκαετίες. Αντίστοιχα, η συστηματική «μόλυνση» των συνόλων δεδομένων εκπαίδευσης με ψευδείς μελέτες, κατασκευασμένες αναφορές, ψευδή προφίλ ειδικών και οργανωμένα δίκτυα αμοιβαίων παραπομπών μπορεί να ενσωματώσει σε ένα μοντέλο λανθασμένα μοτίβα κρίσης, τα οποία στη συνέχεια αναπαράγονται με αξιόπιστο ύφος προς τους χρήστες. Το διακύβευμα δεν είναι μόνο ένα λανθασμένο αποτέλεσμα αναζήτησης, αλλά η σταδιακή διαμόρφωση ενός στρεβλού «υποβάθρου αλήθειας» που επηρεάζει δημοκρατικές επιλογές, στάσεις απέναντι στην επιστήμη, ακόμη και συμπεριφορές σε κρίσιμες πολιτικές ή υγειονομικές καταστάσεις. Επιπλέον, όταν τα μοντέλα ενσωματώνονται σε εκπαιδευτικά, δημοσιογραφικά ή διοικητικά εργαλεία, η αποξένωση από τις πρωτογενείς πηγές και η εξάρτηση από έτοιμες συνόψεις μπορεί να διαβρώσει σταδιακά τις κριτικές δεξιότητες, ιδιαίτερα των νεότερων γενεών.

Ανοιχτή διακυβέρνηση και ακεραιότητα της πληροφορίας

Σε αυτό το περιβάλλον, η απάντηση δεν μπορεί να είναι μόνο τιμωρητική ρύθμιση ή λογοκρισία. Η σύγχρονη ατζέντα της Ανοιχτής Διακυβέρνησης, όπως διαμορφώνεται στο πλαίσιο του Open Government Partnership, τονίζει ότι η αντιμετώπιση της παραπληροφόρησης πρέπει να βασίζεται στην ενίσχυση της ακεραιότητας της πληροφορίας, της διαφάνειας και της συμμετοχής, όχι μόνο στην καταστολή «κακών περιεχομένων».(Open Government Partnership) Αυτό σημαίνει, πρώτον, ανοικτές και προσβάσιμες πληροφορίες για τις ίδιες τις πολιτικές ακεραιότητας πληροφορίας: ποια κριτήρια χρησιμοποιεί το κράτος για να αξιολογεί κινδύνους παραπληροφόρησης, ποιοι φορείς εμπλέκονται, ποια δεδομένα και ποια εργαλεία τεχνητής νοημοσύνης χρησιμοποιούνται. Δεύτερον, συμμετοχικό σχεδιασμό και παρακολούθηση των σχετικών πολιτικών, με τη συστηματική εμπλοκή δημοσιογράφων, ερευνητών, οργανώσεων της κοινωνίας των πολιτών και ομάδων χρηστών που πλήττονται δυσανάλογα από στοχευμένες εκστρατείες παραπληροφόρησης.(Open Government Partnership) Τρίτον, ενίσχυση της ελευθερίας και πολυφωνίας των μέσων ενημέρωσης και της πρόσβασης σε δημοσιογραφία δημοσίου συμφέροντος, ώστε οι πολίτες να έχουν αξιόπιστες εναλλακτικές πηγές σε σχέση με αλγοριθμικά επιμελημένα ρεύματα περιεχομένου.(Forum Information & Democracy)

Η ανοιχτή διακυβέρνηση μπορεί επίσης να συμβάλει με συγκεκριμένες ψηφιακές πολιτικές. Ανοικτά και διασυνδεδεμένα δεδομένα για πολιτικές διαφημίσεις, κυβερνητική επικοινωνία και κρατική χρηματοδότηση προς μέσα και πλατφόρμες επιτρέπουν στην κοινωνία των πολιτών και στους ερευνητές να εντοπίζουν μοτίβα χειραγώγησης και συγκρούσεις συμφερόντων. Συνδυαστικά, η διαφάνεια στα συστήματα τεχνητής νοημοσύνης που χρησιμοποιεί το Δημόσιο, μέσα από μητρώα αλγορίθμων, αξιολόγηση επιπτώσεων στα θεμελιώδη δικαιώματα και ανοικτές διαδικασίες ελέγχου, συμβάλλει στη δημιουργία ενός περιβάλλοντος όπου η τεχνητή νοημοσύνη λειτουργεί υπέρ της λογοδοσίας και όχι ως «μαύρο κουτί» επιρροής.(OECD)

Προς μια εθνική και διεθνή ατζέντα ανθεκτικότητας

Το άρθρο στο Politikon υπογραμμίζει ότι η βιομηχανία της τεχνητής νοημοσύνης δεν αρκεί να αυτορρυθμιστεί και ότι τα ισχυρά ρυθμιστικά πλαίσια είναι αναγκαία αλλά όχι επαρκή. Αναδεικνύεται η ανάγκη για συνδυασμό αυστηρής, προληπτικής ρύθμισης των υπηρεσιών τεχνητής νοημοσύνης, διαφάνειας στις πρακτικές εκπαίδευσης και αξιοποίησης των δεδομένων, καθώς και βαθιών εκπαιδευτικών μεταρρυθμίσεων και μόνιμων δράσεων ενημέρωσης του κοινού. Σε αυτό το σημείο συναντώνται οι επισημάνσεις του Open Government Partnership και του Φόρουμ για την Πληροφοριακή Δημοκρατία, που ζητούν οι πολιτικές για την ακεραιότητα της πληροφορίας στην εποχή της τεχνητής νοημοσύνης να τεθούν στο επίκεντρο των δημοκρατικών μεταρρυθμίσεων και να σχεδιάζονται με ανοιχτές, συμμετοχικές διαδικασίες.(Forum Information & Democracy) Μια εθνική στρατηγική που θα ευθυγραμμίζεται με αυτές τις αρχές θα πρέπει να συνδέει τον έλεγχο και τη διαφάνεια των μοντέλων τεχνητής νοημοσύνης με την ενδυνάμωση των πολιτών ως κριτικών χρηστών πληροφορίας. Να αντιμετωπίζει τις εκστρατείες παραπληροφόρησης όχι μόνο ως ζήτημα ασφάλειας, αλλά και ως πρόκληση δημοκρατικής ποιότητας και κοινωνικής συνοχής. Και, τελικά, να εντάσσει την τεχνητή νοημοσύνη σε μια ευρύτερη πολιτική ανοιχτής διακυβέρνησης, όπου η πληροφορία, τα δεδομένα και τα εργαλεία παραμένουν στην υπηρεσία της δημοκρατίας και όχι το αντίστροφο.

—

Πηγές άρθρου:

- Generative AI as a Disinformation Tool – politikon.iapss.org

- Open Government Partnership – opengovpartnership.org